Czy wysokie koszty API i spadająca wydajność dużych modeli językowych (LLM) w automatyzacji przeglądarek spędzają Ci sen z powiek? Jeśli Twoje systemy zmagają się z przetwarzaniem obszernych dokumentów HTML, a kontekst LLM jest zaśmiecony zbędnymi danymi, to ten artykuł jest dla Ciebie. Wyzwanie związane z nadmiernym zużyciem tokenów to kluczowy czynnik hamujący szerokie i ekonomicznie opłacalne wdrożenia agentów webowych napędzanych przez LLM.

W tym artykule zagłębimy się w świat inteligentnej automatyzacji przeglądarki, koncentrując się na znaczącej redukcji kosztów LLM poprzez innowacyjne podejścia do odchudzania drzewa DOM (Document Object Model) i protokołu Model Context Protocol (MCP). Pokażemy, jak przekształcić problematyczne, pełne szumu dane webowe w zoptymalizowane, semantycznie bogate i łatwo przyswajalne dla LLM reprezentacje.

Oto kluczowe punkty z artykułu:

Wyzwanie obliczeniowe i ekonomika tokenów:

- Obszerne dokumenty HTML generują wysokie koszty API i negatywnie wpływają na jakość działania LLM.

- Zrozumienie struktury kosztów tokenów i potencjalnych oszczędności jest kluczowe dla ekonomicznie opłacalnych wdrożeń.

- Efektywna reprezentacja treści webowych za pomocą drzewa dostępności i migawek jest fundamentem optymalizacji.

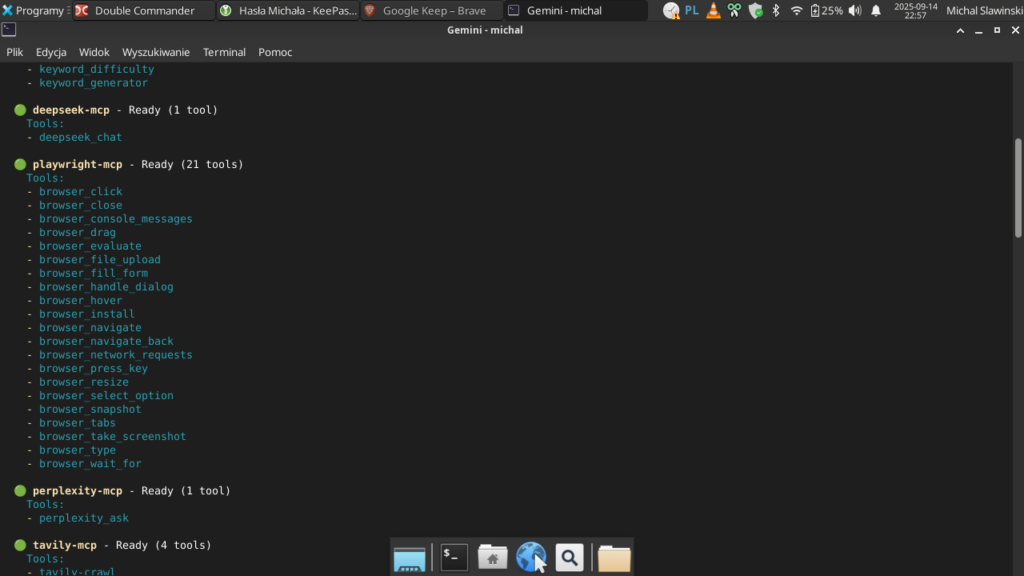

Architektura Model Context Protocol (MCP) i Playwright:

- MCP to otwarty standard standaryzujący komunikację między LLM a zewnętrznymi narzędziami, takimi jak przeglądarki.

- Serwer Playwright MCP wykorzystuje Playwright do generowania strukturalnych migawek dostępności (zamiast zrzutów ekranu), dostarczając LLM lekką, semantycznie bogatą reprezentację strony.

- Skuteczne zarządzanie zasobami i strategie buforowania (dla danych i instancji przeglądarek) są niezbędne do dalszej optymalizacji kosztów.

Kluczowe techniki redukcji danych wejściowych:

- Minimalizacja snapshotów i DOM: Filtrowanie zbędnych elementów, użycie białych list atrybutów/tagów, przypisywanie krótkich ID oraz kompresja HTML za pomocą Emmetify (redukcja tokenów nawet o 63%).

- Selektywne filtrowanie i priorytetyzacja: Koncentracja na elementach najbardziej istotnych dla zadania LLM, z wykorzystaniem narzędzi takich jak LineRetriever.

- Chunking treści i przetwarzanie hierarchiczne: Podział dużych struktur DOM na mniejsze, semantycznie spójne fragmenty, np. za pomocą LangChain’s HTMLSemanticPreservingSplitter, w celu optymalizacji kontekstu.

Drzewo dostępności i podejścia do danych strukturalnych:

- Metadane strukturalne i schemat webMCP: Przekazywanie LLM zwięzłych, JSON-formatted struktur opisujących elementy UI (rola, nazwa, stan, ID), co może przynieść redukcję tokenów nawet do 90% i lepszą dokładność ekstrakcji.

- Synteza treści wizualnych i tekstowych: Priorytetowe wykorzystanie danych strukturalnych, z rzadkim i strategicznym uzupełnianiem o analizę wizualną, gdy dane strukturalne są niewystarczające.

Zaawansowane strategie redukcji tokenów:

- Przetwarzanie dawkowe (batch processing): Grupowanie wielu zapytań do LLM w jedną partię w celu redukcji kosztów i skrócenia czasu odpowiedzi.

- Kaskadowanie modeli i selektywne przetwarzanie: Kierowanie zadań do modeli LLM o różnej wielkości i koszcie, w zależności od złożoności zadania, aby minimalizować ogólne wydatki.

Obsługa CAPTCHA i techniki stealth:

- Wczesne wykrycie CAPTCHA: Rozpoznawanie charakterystycznych elementów DOM.

- Metody rozwiązania CAPTCHA: Integracja z zewnętrznymi serwisami (np. CapSolver, 2Captcha) poprzez API oraz stosowanie technik „stealth” (np. dostosowywanie odcisków palców przeglądarki, naśladowanie ludzkich zachowań) w celu proaktywnego unikania.

Wzorce abstrakcji Page Object Model (POM):

- Definicja POM: Reprezentowanie każdej strony lub komponentu UI jako oddzielnego obiektu z semantycznymi nazwami i rolami.

- Korzyści POM: Redukcja tokenów, zwiększona czytelność i utrzymanie kodu, zwiększona odporność na zmiany UI oraz lepsze rozumowanie LLM.

Praktyczne przykłady i narzędzia:

- Przykłady kodu Playwright do filtrowania DOM i wyciągania widocznych, istotnych elementów.

- Narzędzia takie jak Emmetify do kompresji HTML, formaty CSV/TSV dla danych tabelarycznych (redukcja ponad 50% tokenów) oraz konfiguracja MCP do optymalizacji zrzutów strony.

Obsługa błędów i strategie odporności:

- Wdrożenie mechanizmów takich jak ponowne próby, limity czasu (timeouts), fallbacki i wykrywanie CAPTCHA.

- Szczegółowe logowanie i diagnostyka (kontekst LLM, zrzuty ekranu, DOM).

- Wykorzystanie uczenia maszynowego do przewidywania awarii i automatycznego dostosowywania strategii.

Artykuł podkreśla, że inwestowanie w optymalizację danych wejściowych i budowanie odpornych systemów to strategiczna decyzja biznesowa, która przekłada się na realne korzyści operacyjne i finansowe.

Wprowadzenie do optymalizacji tokenów w automatyzacji przeglądarek pozwoli Ci zrozumieć:

- Wyzwanie obliczeniowe przetwarzania treści webowych – omówimy problem obszernych dokumentów HTML, które generują wysokie koszty API i negatywnie wpływają na jakość działania AI. Pełne DOM strony internetowej to prawdziwa powódź danych, z których większość jest nieistotna dla zadania agenta, co zwiększa liczbę tokenów, opóźnienia i może dezorientować model.

- Ekonomika tokenów w automatyzacji webowej opartej na AI – przyjrzymy się strukturze kosztów tokenów, potencjalnym oszczędnościom oraz korzyściom, które wykraczają poza samą redukcję wydatków, prowadząc do zwiększenia wydajności i niezawodności.

- Podstawy efektywnej reprezentacji treści webowych – wyjaśnimy cel efektywnej reprezentacji, rolę drzewa dostępności i sposoby wykorzystania migawek dostępności do stworzenia zwięzłego, ustrukturyzowanego podsumowania treści strony.

Celem tego kompleksowego przewodnika jest dostarczenie deweloperom, inżynierom AI/ML, architektom systemów oraz technical leadom praktycznych strategii i narzędzi, które pozwolą znacząco obniżyć koszty API związane z LLM w automatyzacji przeglądarek. Dowiesz się, jak zwiększyć wydajność i niezawodność swoich systemów poprzez inteligentną optymalizację przetwarzania danych webowych i zastosowanie odpowiednich architektur.

Przygotuj się na wdrożenie konkretnych rozwiązań, które mogą zredukować zużycie tokenów nawet o 90%, poprawiając jednocześnie precyzję i szybkość działania Twoich agentów. Czytaj dalej, aby odkryć, jak możesz zbudować bardziej efektywne i ekonomiczne systemy automatyzacji oparte na LLM!

Architektura Model Context Protocol (MCP) i Playwright

Aby skutecznie zoptymalizować zużycie tokenów i zwiększyć wydajność agentów webowych opartych na LLM, kluczowe jest zastosowanie odpowiedniej architektury. Model Context Protocol (MCP) w połączeniu z Playwright stanowi potężne rozwiązanie, które standaryzuje komunikację między modelami językowymi a przeglądarkami, umożliwiając efektywne zarządzanie kontekstem i zasobami.

Ramy MCP i korzyści ze standaryzacji

Model Context Protocol (MCP) to otwarty standard, który działa jako uniwersalny interfejs do łączenia LLM z zewnętrznymi narzędziami, źródłami danych i usługami. Jego głównym celem jest zapewnienie formalnego, dwukierunkowego kanału komunikacji, który pozwala LLM odkrywać dostępne narzędzia, rozumieć ich parametry i wywoływać je w ustrukturyzowany sposób. MCP jest niczym uniwersalne złącze USB-C dla aplikacji AI, zapewniając płynną integrację modeli z różnorodnymi zasobami zewnętrznymi – od przeglądarek i baz danych po API i systemy plików – bez konieczności tworzenia niestandardowych integracji dla każdej kombinacji modelu i systemu.

Architektura klient-serwer protokołu MCP jest fundamentalna. Klient (agent AI) wysyła instrukcje do serwera MCP, który następnie tłumaczy je na konkretne działania w docelowym systemie (np. w przeglądarce). Serwer z kolei odsyła ustrukturyzowane odpowiedzi, które LLM może łatwo przetwarzać. Ta standaryzacja zapewnia spójne interfejsy i elastyczność wdrożeń, umożliwiając deweloperom tworzenie agentów, które są przenośne i mogą współpracować z różnymi narzędziami i środowiskami.

Architektura i możliwości serwera Playwright MCP

Serwer Playwright MCP stanowi kluczowy element tej architektury. Playwright, będący potężnym narzędziem do automatyzacji przeglądarek, dzięki integracji z MCP, staje się integralną częścią agentowego frameworku. Serwer Playwright MCP oferuje:

- Obsługę silników przeglądarek: Playwright wspiera wszystkie główne silniki przeglądarek (Chromium, Firefox, WebKit), co pozwala na testowanie i automatyzację w różnych środowiskach z jednego API.

- Zaawansowane narzędzia: Playwright dostarcza bogaty zestaw narzędzi do interakcji ze stronami internetowymi, takich jak klikanie, wypełnianie formularzy, nawigacja czy przechwytywanie zrzutów ekranu. W kontekście MCP, Playwright generuje strukturalne migawki dostępności (structured accessibility snapshot) strony internetowej, co stanowi kluczową różnicę w stosunku do metod opartych na zrzutach ekranu. Migawka ta operuje na ustrukturyzowanych danych z drzewa dostępności, a nie na pikselach. Dostarcza LLM lekką, semantycznie bogatą reprezentację strony, włączając w to role elementów (np. przycisk, pole tekstowe), nazwy, stany i hierarchiczne relacje. Te ustrukturyzowane dane są przyjazne dla LLM, umożliwiając modelowi wnioskowanie o strukturze i funkcji strony bez potrzeby korzystania z modelu wizyjnego.

- Optymalizacja tokenów przez filtrowanie odpowiedzi: Serwer Playwright MCP może być skonfigurowany do filtrowania i minimalizowania danych zwracanych do LLM, co pozwala na redukcję liczby tokenów. LLM nie potrzebuje kodu źródłowego jako kontekstu, ale musi być świadomy renderowanego kodu HTML strony, odwiedzonych adresów URL, przekierowań, wartości plików cookie i migawek pokazujących, jak interakcje zmieniły witrynę.

Zarządzanie zasobami i strategie buforowania

Efektywne zarządzanie zasobami i strategie buforowania są niezbędne do optymalizacji kosztów i zwiększenia wydajności w automatyzacji webowej opartej na AI.

- Mechanizmy buforowania: Implementacja buforowania dla często używanych danych lub fragmentów stron może znacząco zmniejszyć liczbę zapytań do LLM i przeglądarki. Na przykład, jeśli agent często wraca do tej samej sekcji strony, buforowanie jej struktury lub kluczowych danych pozwala uniknąć ponownego przetwarzania.

- Oszczędności tokenów: Buforowanie bezpośrednio przekłada się na oszczędności tokenów, ponieważ LLM otrzymuje już przetworzone i zoptymalizowane dane, zamiast surowych, obszernych informacji z DOM.

- Zarządzanie stanem strony: Aktywne zarządzanie stanem strony, takie jak śledzenie zmian w DOM po interakcjach użytkownika, pozwala na wysyłanie do LLM tylko istotnych aktualizacji, zamiast całego, odświeżonego DOM.

- Optymalizacja instancji przeglądarki: Strategie takie jak ponowne wykorzystanie instancji przeglądarki dla wielu zadań lub inteligentne zamykanie nieużywanych instancji, pozwalają na oszczędność zasobów obliczeniowych i przyspieszenie operacji.

Dzięki połączeniu standaryzacji MCP z możliwościami Playwright, deweloperzy mogą tworzyć zaawansowane agenty AI, które efektywnie wykorzystują kontekst przeglądarki, jednocześnie minimalizując koszty operacyjne i maksymalizując wydajność.

Właśnie przed chwilą zgłębialiśmy tajniki optymalizacji, które pozwalają przekształcić automatyzację przeglądarek z kosztownej i nieprzewidywalnej operacji w precyzyjne, wydajne i niezawodne narzędzie. Przyszłość automatyzacji leży w ekosystemie wyspecjalizowanych, wydajnych i połączonych agentów działających w harmonii, zdolnych do samonaprawy i adaptacji. Nie pozwól, aby wysokie koszty API czy niestabilność systemów hamowały Twój rozwój!

Wezwanie do działania

Wyzwanie związane z wysokimi kosztami i niestabilnością automatyzacji opartej na LLM jest realne, ale, jak pokazaliśmy, istnieją konkretne i sprawdzalne strategie, aby mu sprostać. Masz teraz w ręku wiedzę, która pozwoli Ci znacząco zredukować koszty API, zwiększyć wydajność i niezawodność Twoich systemów. To nie jest teoria – to zestaw praktycznych kroków, które możesz wdrożyć już dziś.

Oto Twoja mapa drogowa do sukcesu:

- Rozpocznij od przetwarzania DOM i snapshotów: Zacznij od najbardziej oczywistych oszczędności. Wdrażaj filtrowanie zbędnych elementów, używaj białych list atrybutów i tagów oraz przydzielaj krótkie identyfikatory. Pamiętaj, że każdy usunięty token to bezpośrednia oszczędność.

- Implementuj Page Object Models (POM): Przejdź na wyższy poziom abstrakcji. Twórz semantyczne reprezentacje interfejsu użytkownika, które pozwolą LLM operować na wysokopoziomowych schematach, zamiast grzęznąć w szczegółach HTML. To zwiększy odporność Twoich systemów na zmiany.

- Eksperymentuj z formatami danych: Nie bój się testować różnych formatów. Kompresja HTML za pomocą narzędzi takich jak Emmetify oraz wykorzystanie formatów CSV/TSV dla danych tabelarycznych to proste, ale niezwykle skuteczne metody redukcji tokenów.

- Monitoruj tokeny i koszty: Wdrażaj systemy monitorowania, które na bieżąco śledzą zużycie tokenów i związane z tym koszty. Tylko w ten sposób będziesz w stanie mierzyć efektywność swoich optymalizacji i identyfikować obszary do dalszej poprawy.

- Przygotuj strategie obsługi CAPTCHA: Nie czekaj, aż CAPTCHA zatrzyma Twoją automatyzację. Wdrażaj proaktywne mechanizmy wykrywania i integracji z usługami rozwiązywania CAPTCHA, aby zapewnić ciągłość działania.

Pamiętaj, że przyszłość automatyzacji leży w Twoich rękach. Podejmij działanie, eksperymentuj i optymalizuj. Masz wszystkie narzędzia i wiedzę, aby zbudować systemy, które nie tylko będą działać, ale będą działać inteligentnie, wydajnie i ekonomicznie.

Bibliografia

- ChatGPT Deep Research. (n.d.). Optimizing LLM Inputs for Playwright/MCP Automation.

- Shen et al. (2024). Common web DOMs can be 10K–100K tokens, and pruned them by retaining only “interactive elements and useful attributes.”

- Kailash Pathak (2025). Illustrates that a POM class lists “buttons, inputs” and interactions – you can mirror that in your prompts (naming each element and type).

- The Agentic Imperative: A Framework for Reducing LLM Token Usage in Playwright-MCP Browser Automation. (n.d.).

Po zrozumieniu, jak architektura MCP i Playwright wspiera komunikację z LLM, kolejnym krokiem jest zastosowanie konkretnych technik redukcji danych wejściowych, aby jeszcze bardziej zoptymalizować zużycie tokenów i zwiększyć efektywność modeli. Przesyłanie całego, surowego DOM strony internetowej lub zrzutu ekranu jest nieekonomiczne i nieefektywne. Zamiast tego, należy wstępnie przetworzyć i skrócić zawartość strony do semantycznego, ustrukturyzowanego podsumowania.

Kluczowe techniki redukcji danych wejściowych

Minimalizacja snapshotów strony i zawartości DOM

Podstawą redukcji tokenów jest minimalizacja rozmiaru migawek strony i zawartości DOM przesyłanych do LLM. Osiąga się to poprzez szereg strategii:

- Filtrowanie zbędnych elementów: Wiele elementów HTML, takich jak niewidoczne kontenery, tagi stylu czy elementy układu

<div>, dodaje masę bez żadnej wartości semantycznej dla LLM. Algorytm może usuwać elementy, które nie są wizualnie ani semantycznie istotne, takie jak te z display:none lub zerowymi wymiarami, a także zbędne div i span pełniące jedynie funkcje opakowań.

- Użycie whitelisty atrybutów i tagów: Skuteczną metodą jest stosowanie białej listy (whitelisty) dla atrybutów i tagów HTML. Na przykład, można zachować tylko interaktywne elementy, takie jak

<button>, <a>, <input>, oraz użyteczne atrybuty, jednocześnie usuwając atrybuty o bardzo niskim stosunku znaków do tokenów (czyli często losowe ID).

- Przypisywanie krótkich ID do elementów: Każdemu pozostałemu, istotnemu elementowi można przypisać krótkie, unikalne ID. Dzięki temu LLM może odwoływać się do konkretnych elementów strony za pomocą zwięzłych identyfikatorów, zamiast długich selektorów CSS czy XPath.

- Kompresja HTML na przykładzie Emmet: Konwersja obszernego kodu HTML na zwięzłą notację, taką jak skróty Emmet, znacząco redukuje liczbę tokenów. Narzędzie Emmetify potrafi przekształcić HTML w skróty Emmet, zachowując jednocześnie całą strukturę i semantykę. Przykładowo, fragment HTML o 59 tokenach może zostać skrócony do 22 tokenów (redukcja o 63%), co pozwala LLM na rekonstrukcję XPathów lub selektorów CSS przy znacznie mniejszej liczbie znaków.

- Przechwytywanie istotnych snapshotów dostępności: Playwright, za pomocą

page.accessibility.snapshot(), domyślnie filtruje większość nieistotnych węzłów, pozostawiając tylko „interesujące” (np. oznaczone kontrolki). Mimo to, nawet domyślne drzewo może być obszerne. Istnieją sugestie, aby dalej optymalizować te migawki, koncentrując się na węzłach o znaczeniu semantycznym.

Selektywne filtrowanie i priorytetyzacja elementów

Poza ogólną minimalizacją, kluczowe jest selektywne filtrowanie i priorytetyzacja elementów na podstawie ich znaczenia dla zadania agenta AI.

- Cel identyfikacja i priorytetyzacja: Celem jest zidentyfikowanie i priorytetyzacja tych części strony, które są najbardziej istotne dla bieżącego zadania LLM.

- Oszczędności LineRetriever: Narzędzia takie jak LineRetriever mogą pomóc w ekstrakcji tylko tych linii kodu, które są bezpośrednio związane z kontekstem.

- Metody filtrowania: Obejmują one filtrowanie na podstawie widoczności, interaktywności, ról ARIA oraz niestandardowych reguł opartych na specyfice zadania. Przykładowo, w formularzu logowania priorytetem będą pola

username, password i przycisk submit, a nie stopka strony.

- Priorytetyzacja kontekstowa: Dane są priorytetyzowane w zależności od aktualnego kontekstu i celu agenta. Jeśli agent ma znaleźć cenę produktu, priorytetem będą elementy związane z ceną, a nie np. komentarze użytkowników.

Chunking treści i przetwarzanie hierarchiczne

Gdy strona jest zbyt duża, aby zmieścić się w pojedynczym kontekście LLM, konieczne staje się chunking treści i przetwarzanie hierarchiczne.

- Cel podziału złożonych struktur: Celem jest podział złożonych struktur DOM na mniejsze, logiczne fragmenty (chunks), które mogą być przetwarzane niezależnie lub w określonej kolejności.

- Podejścia hierarchiczne: Zamiast dzielić na podstawie arbitralnej liczby znaków, stosuje się podejścia hierarchiczne, które zachowują spójność semantyczną fragmentów. Narzędzia takie jak LangChain’s HTMLSemanticPreservingSplitter potrafią analizować HTML i inteligentnie dzielić go na kawałki w oparciu o granice semantyczne, zapewniając, że krytyczne elementy, takie jak tabele i listy, pozostają nienaruszone, a ich kontekst jest zachowany. To podejście jest szczególnie skuteczne w aplikacjach Retrieval-Augmented Generation (RAG).

- Analiza semantyczna: Fragmentowanie opiera się na analizie semantycznej, identyfikując nagłówki, sekcje, listy, tabele i inne logiczne bloki treści.

- Buforowanie fragmentów: Po przetworzeniu, fragmenty mogą być buforowane, co pozwala na szybki dostęp do nich w przyszłości bez konieczności ponownego ich analizowania przez LLM, co dodatkowo redukuje koszty tokenów.

Wprowadzenie tych technik pozwala na przekształcenie obszernych i zaszumionych danych webowych w zoptymalizowany, semantycznie bogaty i łatwo przyswajalny dla LLM kontekst, co bezpośrednio przekłada się na oszczędności kosztów i poprawę jakości działania agentów AI.

Kontynuując temat redukcji danych wejściowych, nie można pominąć roli drzewa dostępności oraz podejść do danych strukturalnych, które stanowią fundament dla efektywnej komunikacji między przeglądarką a dużymi modelami językowymi (LLM). Zamiast polegać na obszernym i często zaszumionym DOM, wykorzystanie ustrukturyzowanych metadanych znacząco optymalizuje proces, zapewniając jednocześnie wysoką jakość i precyzję interakcji agenta AI.

Drzewo dostępności i podejścia do danych strukturalnych

Kluczem do efektywnego przekazywania kontekstu strony do LLM jest wykorzystanie metadanych strukturalnych, które są znacznie bardziej zwięzłe i semantycznie bogate niż surowy HTML. W tym kontekście, protokół webMCP (Model Context Protocol dla przeglądarek) odgrywa centralną rolę. Jest to otwarty standard, który definiuje formalny, dwukierunkowy kanał komunikacji między LLM a przeglądarką, umożliwiając modelowi odkrywanie narzędzi i wywoływanie działań w ustrukturyzowany sposób.

Schemat webMCP to JSON-formatted struktura dla komend i odpowiedzi, która precyzuje, jak interakcje przeglądarki (np. kliknięcia, migawki) są reprezentowane. Zamiast dostarczać LLM surowy kod HTML, schemat ten koncentruje się na semantycznych informacjach, takich jak rola elementu (np. button, input), jego nazwa (etykieta), stan (np. disabled: false) i unikalny identyfikator. Przykładowo, wpis JSON dla przycisku może wyglądać następująco: {"role":"button", "name":"Submit", "disabled":false, "id": 17}. Taka reprezentacja mówi LLM dokładnie, czym jest element i jak jest identyfikowany.

Wyniki redukcji tokenów są imponujące. Dzięki zastosowaniu protokołu webMCP i ustrukturyzowanych migawek dostępności, takich jak te generowane przez better-playwright-mcp, możliwe jest osiągnięcie redukcji tokenów nawet do 90%. Dzieje się tak, ponieważ LLM otrzymuje lekką, semantycznie bogatą reprezentację strony, eliminując potrzebę przetwarzania dużej ilości nieistotnego „szumu”. Co więcej, badania nad ekstrakcją danych webowych pokazują, że płaska reprezentacja JSON, mimo że potencjalnie bardziej obszerna niż agresywnie odchudzony HTML, prowadzi do lepszej dokładności ekstrakcji i minimalnej halucynacji modelu, co podkreśla, że niska liczba tokenów nie zawsze jest jedynym kryterium optymalizacji – kluczowa jest również wydajność LLM.

Wdrożenie metadanych polega na ekstrakcji ról, etykiet, wartości i stanów elementów interfejsu użytkownika i przekazywaniu ich do LLM w postaci kompaktowych obiektów JSON. Klasa page.accessibility.snapshot() w Playwright domyślnie filtruje większość nieistotnych węzłów, zwracając obiekty z polami takimi jak role, name, disabled, co stanowi idealne źródło dla tych ustrukturyzowanych danych.

Synteza treści wizualnych i tekstowych

Mimo że dane strukturalne z drzewa dostępności są wysoce efektywne, w niektórych scenariuszach może być potrzebne podejście hybrydowe, łączące informacje wizualne z tekstowymi.

- Podejście hybrydowe: Chociaż poleganie na drzewie dostępności (zamiast optycznego rozpoznawania znaków – OCR) jest ogólnie bardziej niezawodne i wydajne dla LLM, aby zrozumieć i wchodzić w interakcje z zawartością strony, istnieją przypadki, w których kontekst wizualny może uzupełniać dane strukturalne. Może to dotyczyć elementów bez jasnych etykiet semantycznych, złożonych układów, gdzie wskazówki wizualne są kluczowe, lub weryfikacji, czy element jest faktycznie widoczny na stronie.

- Wizualna analiza treści: W takich sytuacjach, wizualna analiza treści (np. za pomocą modeli wizyjnych) może dostarczyć dodatkowych informacji. Jednak kluczowe jest, aby była ona używana oszczędnie i tylko wtedy, gdy dane strukturalne są niewystarczające, aby uniknąć zwiększania kosztów tokenów i opóźnień.

- Optymalizacja obrazów: Jeśli konieczne jest przetwarzanie wizualne, optymalizacja obrazów (np. kompresja, zmiana rozmiaru lub ekstrakcja kluczowych cech) staje się niezbędna, aby zminimalizować obciążenie danych i czas przetwarzania dla modeli wizyjnych, analogicznie do optymalizacji DOM dla danych tekstowych.

Podsumowując, priorytetem jest dostarczanie LLM semantycznie bogatych, ustrukturyzowanych danych z drzewa dostępności za pośrednictwem protokołu webMCP. Wizualna analiza powinna stanowić uzupełnienie, stosowane strategicznie, aby wypełnić luki w zrozumieniu, a nie zastępować bardziej efektywne podejścia oparte na danych strukturalnych.

Po zoptymalizowaniu danych wejściowych za pomocą drzewa dostępności i schematów strukturalnych, kolejnym etapem w dążeniu do efektywności i redukcji kosztów jest zastosowanie zaawansowanych strategii zarządzania interakcjami z LLM. Te techniki koncentrują się na optymalizacji sposobu, w jaki zapytania są formułowane, grupowane i kierowane do różnych modeli, maksymalizując wykorzystanie dostępnych zasobów i minimalizując wydatki na tokeny.

Zaawansowane strategie redukcji tokenów

Przetwarzanie dawkowe i optymalizacja zapytań

Przetwarzanie dawkowe (batch processing) to kluczowa strategia w optymalizacji kosztów i wydajności wdrożeń LLM, szczególnie w scenariuszach, gdzie wiele agentów AI działa jednocześnie lub przetwarza podobne zadania.

- Korzyści z przetwarzania dawkowego: Główną korzyścią jest możliwość wysyłania wielu zapytań do LLM w jednej, skonsolidowanej partii. Zamiast płacić za nagłówek i stopkę każdego indywidualnego zapytania, przetwarzanie dawkowane pozwala na amortyzację tych kosztów na wiele zapytań, co prowadzi do znacznych oszczędności tokenów i skrócenia czasu oczekiwania. Modele LLM, takie jak GPT-4, są zoptymalizowane do przetwarzania wsadowego, oferując lepszą przepustowość i niższe koszty per token przy większych, zbiorczych zapytaniach.

- Implementacja: Implementacja przetwarzania dawkowego polega na gromadzeniu wielu niezależnych zapytań lub zadań, które mają być wykonane przez LLM, a następnie wysyłaniu ich jako pojedynczego, większego zapytania. W kontekście automatyzacji przeglądarki, może to oznaczać grupowanie wielu interakcji (np. kliknięć na różne elementy) lub ekstrakcji danych z wielu podobnych stron.

- Współdzielenie kontekstu: W przypadku zadań, które współdzielą wspólny kontekst (np. analiza wielu elementów na tej samej stronie), przetwarzanie dawkowane może być jeszcze bardziej efektywne. Wspólny kontekst strony może być przesłany raz, a następnie LLM może przetwarzać wiele konkretnych zapytań odnoszących się do tego samego kontekstu.

- Oszczędności w dużych wdrożeniach: W dużych wdrożeniach, gdzie tysiące lub miliony zapytań są przetwarzane dziennie, oszczędności wynikające z przetwarzania dawkowego mogą być kolosalne, znacząco obniżając operacyjne koszty infrastruktury AI.

Kaskadowanie modeli i selektywne przetwarzanie

Kaskadowanie modeli to zaawansowana strategia, która polega na wykorzystaniu hierarchii modeli LLM o różnej wielkości, złożoności i koszcie, aby selektywnie przetwarzać zadania, minimalizując w ten sposób ogólne wydatki na tokeny.

- Strategia kierowania zadań: Podstawą tej strategii jest kierowanie zadań do najbardziej odpowiedniego modelu. Proste, rutynowe zadania, które nie wymagają głębokiego rozumienia ani złożonego wnioskowania, są obsługiwane przez mniejsze, tańsze modele. Bardziej złożone problemy, które wymagają większej mocy obliczeniowej i szerszego kontekstu, są przekazywane do większych, droższych modeli.

- Oszczędności na wydatkach tokenowych: Główne oszczędności wynikają z unikania użycia drogich modeli do zadań, które mogą być efektywnie rozwiązane przez tańsze alternatywy. Na przykład, mały model może służyć jako „filtryzator” lub „router”, oceniając złożoność zapytania i decydując, czy może je obsłużyć samodzielnie, czy też wymaga eskalacji do większego modelu.

- Implementacja routingu: Implementacja routingu wymaga stworzenia mechanizmu, który analizuje przychodzące zapytania i na podstawie predefiniowanych kryteriów (np. długości zapytania, obecności słów kluczowych, złożoności zadania) decyduje, który model zostanie użyty. Może to być zaimplementowane za pomocą prostych reguł, klasyfikatorów maszynowego uczenia lub nawet małego LLM działającego jako „router”.

- Routing dynamiczny: Bardziej zaawansowane podejścia obejmują routing dynamiczny, gdzie decyzja o wyborze modelu jest podejmowana w czasie rzeczywistym, w oparciu o bieżące obciążenie, dostępność modeli lub nawet historyczną wydajność modeli dla podobnych zadań. Taka elastyczność pozwala na dalszą optymalizację kosztów i zapewnienie wysokiej responsywności systemu.

Wdrożenie tych zaawansowanych strategii, w połączeniu z wcześniejszymi technikami redukcji danych wejściowych, tworzy kompleksowy framework do zarządzania kosztami i wydajnością systemów automatyzacji przeglądarek opartych na LLM, umożliwiając deweloperom i inżynierom budowanie bardziej ekonomicznych i skalowalnych rozwiązań.

Po optymalizacji danych wejściowych i strategii zarządzania zapytaniami do LLM, kolejnym krytycznym wyzwaniem w automatyzacji przeglądarek są mechanizmy obronne, takie jak CAPTCHA. Skrypty oparte na Playwright domyślnie zawiodą w konfrontacji z nimi, dlatego niezbędne jest zastosowanie specjalistycznych i solidnych podejść, które pozwolą na płynną kontynuację zadań agenta AI.

Obsługa CAPTCHA i techniki stealth

Wczesne wykrycie CAPTCHA

Kluczowym elementem skutecznego radzenia sobie z CAPTCHA jest ich wczesne i precyzyjne wykrycie. Zanim agent podejmie próbę rozwiązania, musi najpierw zidentyfikować, że na stronie pojawił się mechanizm weryfikacyjny.

- Rozpoznawanie elementów: Wykrywanie CAPTCHA opiera się na rozpoznawaniu specyficznych elementów DOM, które są charakterystyczne dla różnych typów CAPTCHA. Mogą to być określone

iframe’y (np. dla reCAPTCHA), specyficzne klasy CSS, identyfikatory elementów (id) lub unikalne teksty pojawiające się w interfejsie.

- Przykłady wykrycia: W przypadku reCAPTCHA, agent może skanować DOM w poszukiwaniu

iframe z atrybutem src zawierającym google.com/recaptcha/api. Dla innych typów CAPTCHA, może to być poszukiwanie obrazów z zniekształconym tekstem, pól tekstowych z prośbą o wpisanie znaków z obrazka, czy interaktywnych elementów wymagających przeciągania lub układania puzzli. Agent powinien być zaprogramowany do aktywnego monitorowania tych elementów i natychmiastowego reagowania, gdy zostaną wykryte.

Metody rozwiązania CAPTCHA

Po wykryciu CAPTCHA, agent musi zastosować odpowiednią metodę rozwiązania. Chociaż idealnym scenariuszem jest unikanie CAPTCHA poprzez techniki „stealth”, często konieczne jest ich bezpośrednie rozwiązanie.

- Zewnętrzne serwisy: Najbardziej powszechną i niezawodną metodą obsługi CAPTCHA jest integracja ze specjalistycznymi, opartymi na API serwisami rozwiązującymi CAPTCHA, takimi jak CapSolver czy 2Captcha. Usługi te wykorzystują zaawansowaną sztuczną inteligencję, a w niektórych przypadkach również ludzkich operatorów, aby dostarczać rozwiązania w czasie rzeczywistym.

- Automatyzacja z Playwright i API solvera: Proces integracji jest dobrze zdefiniowany. Skrypt agenta musi zawierać niestandardową akcję, która:

- Wykrywa obecność elementu CAPTCHA (np.

iframe reCAPTCHA).

- Wyodrębnia niezbędne informacje (np. klucz witryny i URL).

- Wywołuje API zewnętrznego serwisu.

- Czeka na odpowiedź zawierającą token rozwiązania.

- Wstrzykuje otrzymany token rozwiązania z powrotem do strony, umożliwiając kontynuację interakcji.

Biblioteki takie jak

2captcha-python ułatwiają tę integrację.

- Uwagi etyczne i praktyczne: Należy pamiętać, że rozwiązywanie CAPTCHA często jest sprzeczne z warunkami świadczenia usług witryny, dlatego należy stosować je rozsądnie. Z praktycznego punktu widzenia, pierwszym krokiem w obronie przed CAPTCHA powinno być proaktywne unikanie ich, poprzez zastosowanie technik stealth. Obejmuje to dostosowywanie „odcisków palców” przeglądarki (ang. browser fingerprints) za pomocą wtyczek stealth, używanie serwerów proxy oraz naśladowanie ludzkich zachowań. Wprowadzanie losowości w ruchach myszy i naciśnięciach klawiszy może oszukać behawioralne CAPTCHA. Jeśli jednak bot nieuchronnie natrafi na CAPTCHA, automatyczne rozwiązanie za pomocą API zewnętrznego serwisu pozostaje praktycznym rozwiązaniem awaryjnym.

Podsumowując, skuteczna obsługa CAPTCHA w automatyzacji przeglądarek wymaga połączenia wczesnego wykrywania, strategicznego wykorzystania zewnętrznych serwisów rozwiązujących oraz proaktywnych technik stealth, aby zminimalizować ryzyko i zapewnić płynność działania agentów AI.

Po skutecznym zarządzaniu CAPTCHA i wdrożeniu technik stealth, kolejnym krokiem w budowaniu solidnych i skalowalnych systemów automatyzacji przeglądarek jest zastosowanie wzorców projektowych, które zwiększają czytelność, modularność i łatwość utrzymania kodu. Jednym z najskuteczniejszych wzorców w tym kontekście jest Page Object Model (POM), który, choć tradycyjnie stosowany w testowaniu UI, doskonale adaptuje się do potrzeb automatyzacji opartej na LLM.

Wzorce abstrakcji Page Object Model (POM)

Definicja POM

Page Object Model (POM) to wzorzec projektowy, który ma na celu abstrakcję interfejsu użytkownika (UI) poprzez reprezentowanie każdej strony lub istotnego komponentu strony internetowej jako oddzielnego obiektu. W kontekście automatyzacji z LLM, oznacza to definiowanie UI poprzez role i semantyczne nazwy, a nie surowe selektory CSS czy XPath. Chodzi o tworzenie warstwy abstrakcji, która oddziela logikę biznesową (co agent ma zrobić) od szczegółów technicznych implementacji UI (jak znaleźć dany element).

Model opisujący UI: Wzorem POM, każda strona lub komponent UI jest opisany jako zbiór kluczowych elementów (np. przyciski, pola tekstowe, linki) wraz z ich semantycznymi nazwami lub rolami oraz dozwolonymi akcjami. Zamiast odwoływać się do div#x > input[name="user"], agent operuje na pole_tekstowe_nazwa_uzytkownika.

Przykład JSON POM: W automatyzacji LLM, ten model może być reprezentowany jako struktura danych JSON (lub CSV dla większej zwięzłości), która opisuje istotne elementy strony.

Przykład dla strony logowania:

{

"page": "LoginPage",

"elements": [

{"id": 1, "role": "textbox", "label": "Username"},

{"id": 2, "role": "textbox", "label": "Password"},

{"id": 3, "role": "button", "label": "Log In"}

]

}

Przekazanie takiego kompaktowego obiektu do LLM, zamiast pełnego kodu HTML, drastycznie zmniejsza liczbę tokenów wejściowych. Można nawet przechowywać te obiekty JSON POM i prosić LLM o używanie ich jako kontekstu.

Korzyści POM:

- Redukcja tokenów: LLM widzi wysokopoziomowy schemat UI, a nie zaśmiecony kod HTML. To znacznie zmniejsza liczbę tokenów, co przekłada się na niższe koszty i szybsze przetwarzanie.

- Zwiększona czytelność i utrzymanie: Kod agenta staje się bardziej czytelny i łatwiejszy w utrzymaniu, ponieważ operuje na terminach domenowych (np. „przyciskzaloguj”, „poleemail”) zamiast na skomplikowanych selektorach.

- Zwiększona odporność na zmiany UI: Jeśli zmieni się wewnętrzna struktura HTML elementu (np. selektor CSS), wystarczy zaktualizować definicję w obiekcie POM, a nie modyfikować logikę agenta w wielu miejscach.

- Lepsze rozumowanie LLM: Modele LLM łatwiej rozumieją i wnioskują na podstawie etykietowanych elementów i ich ról, co jest zgodne z ich treningiem.

Działanie wysokopoziomowej specyfikacji: Dzięki POM, LLM otrzymuje wysokopoziomową specyfikację UI, która jest już wstępnie przetworzona i zoptymalizowana. Zamiast analizować cały DOM, model skupia się na istotnych elementach i ich funkcjach. Można również dynamicznie aktualizować lub wzbogacać POM poprzez kod; na przykład, po załadowaniu strony Playwright może listować widoczne przyciski i przechowywać je w obiekcie JSON POM dla LLM. To pozwala zachować równowagę między statycznymi definicjami POM a surowymi migawkami strony.

Po omówieniu wzorca Page Object Model (POM) jako sposobu na abstrakcję UI i optymalizację wejść dla LLM, naturalnym krokiem jest zagłębienie się w praktyczne implementacje i narzędzia, które wspierają te strategie. Skuteczne wdrożenie optymalizacji danych wejściowych wymaga konkretnych technik kodowania i wykorzystania wyspecjalizowanych narzędzi.

Praktyczne przykłady i narzędzia

Przykład kodu Playwright

Kluczowym elementem optymalizacji jest ograniczenie zawartości DOM przekazywanej do LLM tylko do tych elementów, które są rzeczywiście istotne i widoczne dla użytkownika. Pomija to zbędne elementy layoutu (<div>), ukryte kontenery czy znaczniki stylów, które zwiększają liczbę tokenów bez dostarczania wartościowych informacji.

Ograniczenie DOM do widocznych elementów: W Playwright można to osiągnąć, filtrując elementy na podstawie ich widoczności i typu. Poniższy przykład w Node.js demonstruje, jak pobrać tylko widoczny tekst z elementów <a> (linków) i <button> (przycisków):

const { chromium } = require('playwright');

(async () => {

const browser = await chromium.launch();

const page = await browser.newPage();

await page.goto('https://example.com');

// Wyciągnij tylko widoczny tekst z elementów <a> i <button>

const items = await page.$$eval('a, button', els =>

els.filter(el => el.offsetParent !== null).map(el => ({

role: el.tagName.toLowerCase(),

text: el.innerText.trim()

}))

);

console.log(items);

await browser.close();

})();

Ten kod zwraca małą tablicę obiektów, takich jak [{role:"a",text:"Home"}, {role:"button",text:"Next"}], zamiast pełnego, obszernego kodu HTML. Podobne podejście można zastosować do innych typów elementów, bazując na ich rolach (np. textbox, checkbox). Istnieją również propozycje w społeczności Playwright MCP dotyczące wbudowanego narzędzia do wstępnego przetwarzania zrzutów, które automatycznie usuwałoby ogólne elementy opakowujące. Można to również zaimplementować ręcznie, rekurencyjnie usuwając węzły z role=null i pustymi dziećmi lub sprawdzając atrybuty CSS takie jak aria-hidden=true czy style.display='none'.

Narzędzia wspierające optymalizację

Oprócz bezpośrednich modyfikacji kodu, istnieją narzędzia, które dodatkowo wspomagają optymalizację danych wejściowych dla LLM.

- Emmetify: To narzędzie open-source, dostępne poprzez

pip install emmetify, służy do kompresowania obszernego kodu HTML do zwięzłej notacji Emmet. Konwertując HTML do tej skondensowanej formy, można znacząco zredukować liczbę tokenów. Emmetify można również skonfigurować tak, aby pomijało określone znaczniki lub atrybuty, co pozwala na dalsze dostosowanie i precyzyjną kontrolę nad liczbą tokenów. Przykładowo, na jednym fragmencie HTML Emmetify wykazało 63% redukcji tokenów.

- CSV TSV: Formatowanie danych tabelarycznych jako CSV (Comma Separated Values) lub TSV (Tab Separated Values) zamiast JSON może przynieść znaczne korzyści w redukcji tokenów. Eksperymenty wykazały, że wysyłanie danych tabelarycznych do modeli LLM w formacie CSV zamiast JSON może skutkować redukcją tokenów o ponad 50%, co bezpośrednio przekłada się na niższe koszty i szybsze przetwarzanie. Ta technika jest szczególnie przydatna przy przekazywaniu danych z tabel na stronach internetowych.

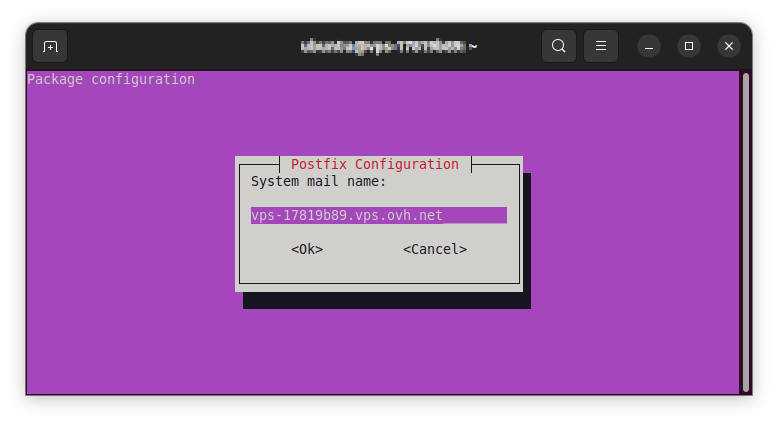

- MCP Configuration: Microsoft Playwright Model Context Protocol (MCP) to protokół, który ułatwia integrację Playwright z LLM. W ramach konfiguracji MCP, istnieje możliwość zdefiniowania, w jaki sposób zrzuty strony są przygotowywane i przesyłane do modelu. Dobre praktyki MCP obejmują przycinanie nieistotnych węzłów DOM, wydobywanie zwięzłego drzewa dostępności oraz formatowanie danych jako kompaktowy JSON lub CSV. Te kroki drastycznie obniżają zużycie tokenów (i koszty), poprawiają wydajność i ułatwiają zadanie LLM, co jest zgodne z ogólnymi zasadami optymalizacji wejść dla LLM.

Optymalizacja wejść dla LLM i wykorzystanie wzorca POM to kluczowe kroki w budowaniu efektywnych systemów automatyzacji przeglądarek. Jednak nawet najlepiej zaprojektowane systemy napotykają na nieoczekiwane błędy i zmiany w środowisku. Dlatego równie ważne jest wdrożenie solidnych mechanizmów obsługi błędów i strategii odporności, które zapewnią ciągłość działania i minimalizację przestojów.

Obsługa błędów i strategie odporności

Cel utrzymania korzyści

Głównym celem implementacji robustnych mechanizmów obsługi błędów jest utrzymanie korzyści płynących z optymalizacji i wydajności, nawet w obliczu dynamicznych i często nieprzewidywalnych zmian w interfejsach użytkownika czy zachowaniach stron internetowych. Systemy automatyzacji oparte na LLM muszą być zdolne do adaptacji i samonaprawy, aby unikać kosztownych przerw w działaniu i konieczności ręcznych interwencji.

- Implementacja mechanizmów odporności: W kontekście automatyzacji z LLM, odporność oznacza zdolność systemu do wykrywania, reagowania i odzyskiwania po błędach. Przykładowo, można zastosować:

- Ponowne próby (retries): W przypadku przejściowych błędów sieciowych lub tymczasowej niedostępności elementu, system powinien automatycznie ponawiać próbę wykonania akcji po krótkim opóźnieniu.

- Timeouts: Definiowanie limitów czasu na wykonanie operacji zapobiega zawieszaniu się systemu w nieskończoność w przypadku braku odpowiedzi.

- Fallbacki: W sytuacji, gdy główna ścieżka działania zawiedzie, system może przełączyć się na alternatywną metodę wykonania zadania (np. użycie innego selektora, jeśli pierwotny nie działa).

- Wykrywanie CAPTCHA: Jak wspomniano wcześniej, proaktywne wykrywanie CAPTCHA i wdrożenie mechanizmów ich rozwiązywania (np. poprzez usługi stron trzecich) jest kluczowym elementem odporności.

- Strategie oparte na różnicach (Diff-Based Optimization): W długotrwałych sesjach, zamiast przesyłać pełne migawki strony, agent może wysyłać tylko „różnice” (diffy) zmian, które zaszły. To drastycznie redukuje zużycie tokenów i zwiększa odporność na drobne, dynamiczne zmiany na stronie.

- Logowanie i diagnostyka: Szczegółowe logowanie jest fundamentem skutecznej obsługi błędów. Powinno ono obejmować:

- Zapisywanie kontekstu LLM: Co model widział i jakie instrukcje otrzymał.

- Zrzuty ekranu i DOM: W momencie wystąpienia błędu, zapisanie zrzutu ekranu i aktualnego stanu DOM może być nieocenione w post-mortem.

- Śledzenie ścieżki wykonania: Rejestrowanie kroków, które doprowadziły do błędu, pomaga zidentyfikować przyczynę.

- Metryki wydajności: Monitorowanie czasu odpowiedzi, zużycia tokenów i wskaźników sukcesu/porażki pozwala na wczesne wykrywanie problemów.

- Uczenie maszynowe do przewidywania awarii: Zaawansowane systemy mogą wykorzystywać uczenie maszynowe do analizy historycznych danych z logów i metryk w celu przewidywania potencjalnych awarii. Można trenować modele, które:

- Identyfikują wzorce błędów: Czy konkretne typy błędów pojawiają się po określonych zmianach na stronie?

- Przewidują niestabilność UI: Na podstawie analizy zmian w DOM i interakcji użytkowników, model może przewidzieć, które części UI są najbardziej podatne na awarie.

- Automatycznie dostosowują strategie: W odpowiedzi na przewidywane problemy, system może dynamicznie zmieniać strategie automatyzacji (np. używać bardziej ogólnych selektorów, zwiększać opóźnienia).

- Automatyczne etykietowanie elementów: Można trenować modele do etykietowania elementów interfejsu użytkownika (np. „emailfield”, „passwordfield”, „login_button”) na podstawie ich atrybutów, co zwiększa odporność na zmiany w nazwach klas czy identyfikatorach.

W sumie, przyszłość automatyzacji leży w ekosystemie wyspecjalizowanych, wydajnych i połączonych agentów działających w harmonii, zdolnych do samonaprawy i adaptacji.

Po szczegółowym omówieniu technik optymalizacji danych wejściowych dla LLM, praktycznych narzędzi i strategii odporności, nadszedł czas na podsumowanie kluczowych wniosków i sformułowanie rekomendacji, które pozwolą w pełni wykorzystać potencjał automatyzacji przeglądarek. Wdrożenie tych zasad nie tylko zwiększy efektywność, ale także znacząco obniży koszty operacyjne.

Kluczowe wnioski i rekomendacje

Najważniejsze zasady

Skuteczna optymalizacja systemów automatyzacji przeglądarek opartych na LLM opiera się na kilku fundamentalnych zasadach:

- Redukcja tokenów: Zawsze dąż do minimalizacji liczby tokenów przesyłanych do LLM. Ograniczanie DOM do widocznych i interaktywnych elementów, usuwanie zbędnych węzłów i atrybutów oraz wykorzystywanie różnic (diffów) w długotrwałych sesjach to kluczowe strategie. Każdy zaoszczędzony token to mniejszy koszt i szybsza odpowiedź modelu.

- Używanie semantycznych danych: Zamiast surowego kodu HTML, dostarczaj LLM ustrukturyzowane, semantyczne podsumowania. Wykorzystaj drzewa dostępności i spłaszczone reprezentacje JSON, które jasno etykietują elementy interfejsu użytkownika, ułatwiając modelowi interpretację i redukując ryzyko halucynacji.

- Kompresja HTML i danych tabelarycznych: Wykorzystuj narzędzia takie jak Emmetify do kompresji obszernego kodu HTML do zwięzłej notacji Emmet, co może przynieść ponad 60% redukcji tokenów. Dla danych tabelarycznych stosuj formaty CSV lub TSV zamiast JSON. Eksperymenty wykazały, że format CSV może zredukować zużycie tokenów o ponad 50% w porównaniu do JSON, co jest szczególnie cenne przy dużych zbiorach danych.

- Tworzenie wysokopoziomowych schematów UI: Implementacja wzorca Page Object Model (POM) i tworzenie abstrakcji UI pozwala na dostarczanie LLM wysokopoziomowych instrukcji, które są niezależne od drobnych zmian w interfejsie. To zwiększa odporność systemu i ułatwia zarządzanie złożonymi interakcjami.

- Wczesne wykrywanie i obsługa CAPTCHA: Proaktywne mechanizmy wykrywania i rozwiązywania CAPTCHA są niezbędne dla zapewnienia ciągłości działania automatyzacji. Wczesna detekcja pozwala na szybkie przekierowanie do usług rozwiązywania CAPTCHA, minimalizując przestoje.

Korzyści z wdrożenia

Wdrożenie powyższych zasad przynosi wymierne korzyści, które mają bezpośredni wpływ na efektywność i ekonomię systemów automatyzacji:

- Zwiększona wydajność i niezawodność: Mniejsza liczba tokenów oznacza szybsze przetwarzanie zapytań przez LLM i krótszy czas odpowiedzi. Ustrukturyzowane dane i mechanizmy odpornościowe, takie jak ponowne próby czy fallbacki, sprawiają, że system jest bardziej stabilny i mniej podatny na awarie.

- Znaczne oszczędności kosztów API: Ponieważ większość dostawców API LLM rozlicza się na podstawie liczby tokenów, każda redukcja tokenów przekłada się bezpośrednio na niższe koszty operacyjne. Badania wykazały, że optymalizacje mogą obniżyć koszty API o ponad 50% w przypadku danych tabelarycznych. Dla dużych operacji oznacza to znaczące oszczędności finansowe.

- Lepsza interpretacja przez LLM: Dostarczanie LLM czystych, precyzyjnych i semantycznie bogatych danych wejściowych znacznie ułatwia mu zadanie. Model jest w stanie dokładniej interpretować intencje, podejmować trafniejsze decyzje i generować bardziej niezawodne wyniki, redukując ryzyko halucynacji i błędnych akcji.

Podsumowując, inwestowanie w optymalizację danych wejściowych dla LLM i budowanie odpornych systemów to nie tylko kwestia techniczna, ale strategiczna decyzja biznesowa, która przekłada się na realne korzyści operacyjne i finansowe.\n\n—–\n\nArtykuł „Inteligenta automatyzacja przeglądarki – redukcja kosztów LLM przez odchudzanie DOM i MCP” to kompleksowy przewodnik dla deweloperów, inżynierów AI/ML i architektów systemów, który koncentruje się na optymalizacji systemów automatyzacji przeglądarek opartych na dużych modelach językowych (LLM). Głównym celem jest znacząca redukcja kosztów API LLM oraz zwiększenie wydajności i niezawodności tych systemów.